Neues vom Level 4 (2) Neues vom Level 4 (2)

| Robo-Taxi im Nebel gestrandet . . . |

Level 4 das gibt es eher in China und in USA als bei uns. Wobei wir hier jetzt Deutschland meinen, nicht genügend Überblick haben, ob es anderswo in Europa weniger strenge Regeln für die Zulassung gibt.

Ja, jede Erweiterung muss durch die Typprüfung, bevor sie in Kundenhand darf.

Ja, die deutschen Behörden sind schon fast verschrien, aber auch nur ein Todesfall, bei dem eindeutig nachgewiesen werden kann, dass er bei einem/r menschlichen Fahrer/in mit hoher Wahrscheinlichkeit

nicht passiert wäre, reicht, um die gesamte Branche in Verruf zu bringen.

Wie gesagt, man wäre froh, wenn im privaten Bereich zumindest schon irgendwo Level 3 erreicht worden wäre. Stattdessen rettet man sich mit Pluszeichen hinter der Bezeichnung 'Level 2'. Selbst über den

Spurwechsel darf das Auto nicht vollständig alleine entscheiden.

Man möchte wetten, dass die Systeme mehr können, es nur nicht zeigen dürfen. Schauen Sie sich die Fortschritte bei Light Detection and Ranging an. Das Grundprinzip:

Ein Laserpuls (sehr kurz aufrechterhaltener Laserstrahl) wird ausgesendet. Er trifft z.B. auf eine Nebelwand.

Wenn diese nicht zu dicht ist, kann er sie durchdringen. Allerdings hat man für stärkeren Nebel noch Radar an Bord. Besser als Kameras sind Laser allerdings, z.B. auch weil sie ein sogenanntes aktives

Medium sind. Kameras können im Prinzip nur flächige (zweidimensionale) Bilder erzeugen.

So ein Laserpuls hat also den (leichteren) Nebel unbeschadet durchdrungen und trifft auf ein Objekt. Jetzt gibt es drei Möglichkeiten, der Strahl wird zurückgeworfen (Reflexion), vom Objekt aufgenommen oder

in Wärme umgewandelt (Adsorpion).

Er kann aber auch durch das Objekt in viele Richtungen verteilt werden (Streuung), wobei natürlich der meiste Wert auf den zurückkehrenden Teil gelegt wird. Es handelt sich dabei, eben ähnlich dem Licht,

immer um Photonen, die diese Strecken mit Lichtgeschwindigkeit zurücklegen.

Da man die Geschwindigkeit kennt, kann man aus der Zeit auf die zurückgelegte Distanz schließen. D.h. erkannte Objekte existieren nicht nebeneinander wie beim Bild einer Kamera, sondern ergeben eine

gemessene Tiefe, im Prinzip also ein exaktes 3D-Bild.

Lidar arbeitet mit eigener Energie, während eine Kamera auf das Licht angewiesen ist, das sie vorfindet. Auch daher die bessere Durchdringung z.B. von Nebel. Es gibt Lidar-Hersteller, die auch Software z.B. von

Nvidia anbieten, um die Art der Objekte direkt benennbar zu machen.

Im Automotive-Bereich hat sich eine Wellenlänge im nahen Infrarot-Bereich von 905 Nanometer durchgesetzt. Nur vereinzelt gibt es solche, die mit 1550 Nanometer und damit teureren Bauteilen arbeiten. Ganz

ungefährlich ist der Laserstrahl für das menschliche Auge nicht.

Hineinschauen sollte man auch bei stehendem Fahrzeug nicht, weil eine Abschaltung nicht sicher ist. Das abgestrahlte Laserlicht ist aber auch gesetzlich geregelt. Für Kameras soll es bisweilen sogar

bedenklicher als für die Augen sein.

Die Gesamtleistung von Lidar hängt wohl hauptsächlich von der Pulsrate ab. Große Reichweite bis maximal 300 Meter ergibt allerdings geringere Auflösung, was auch die Objekterkennung erschwert. Hinzu

kommt noch die Energie pro Puls, wobei die gesetzlichen Bestimmungen (Augen) beachtet werden müssen.

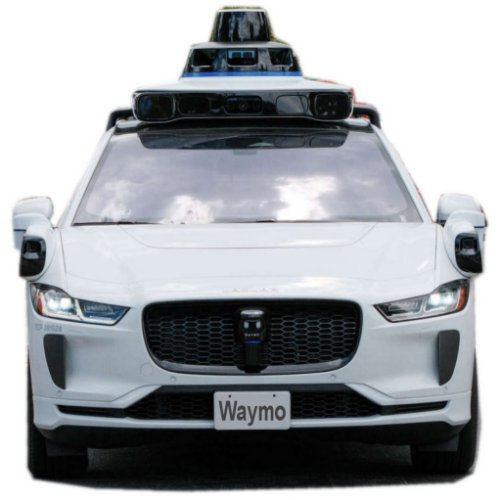

Und dann gibt es auch noch unterschiedliche Vorgehensweisen beim Scannen der Umgebung. Übrigens, die alten, vollkommen rundlaufenden Sensoren gibt es wohl nicht mehr, weshalb man insgesamt

mindestens je einen nach vorn/hinten und vier an allen Ecken braucht.

| Deutsche Untertitel sind möglich . . . |

|